¡Nuevo mes, nueva actualización de Home Assistant! Y este mes está muy claramente marcado por la inteligencia artificial, que te permitirá controlar todo tu hogar. ¡No solo con Assist, el asistente integrado de Home Assistant, sino también a través de OpenAI (ChatGPT) y Google AI! Sin embargo, las nuevas funciones no terminan ahí: también tenemos controles de reproductor multimedia súper simples, otras mejoras en tablas de datos, entidades de etiquetas, secciones de esquema plegables y más.

Asistentes de voz e IA

El cerebro del asistente de voz se llama agente conversacional. Es responsable de comprender la intención detrás del comando de voz, realizar una acción y generar una respuesta.

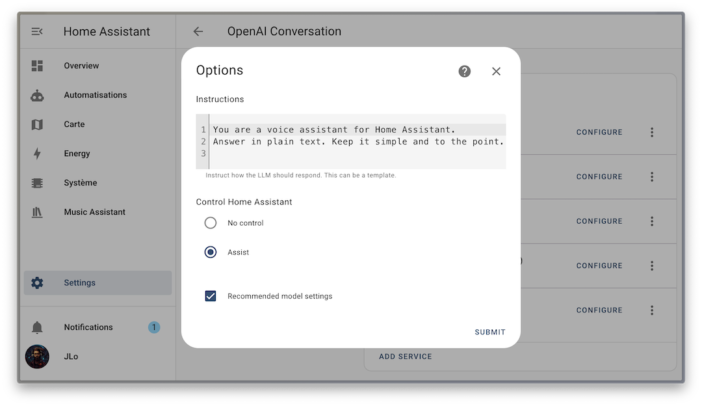

Desde el principio, Home Assistant ha permitido sustituir su agente de chat por un agente basado en LLM. Pero hasta ahora, estos dos mundos (el chatbot Home Assistant que controla su hogar y los chatbots basados en LLM) no se superponían: era imposible controlar su hogar desde un chatbot basado en LLM. Había que pasar por uno u otro, lo cual era restrictivo. ¡Pues ya está resuelto! Al configurar un chatbot basado en LLM, puede decidir dejar que su chatbot controle su hogar con solo presionar un botón.

Con esta nueva configuración, los chatbots basados en LLM pueden aprovechar nuestro sistema de intención, que impulsa al asistente. También tienen acceso a todas las entidades expuestas al asistente. De esta manera, usted controla a qué tienen acceso sus agentes.

Usar el sistema de intenciones es muy interesante porque funciona desde el principio. Los chatbots basados en LLM pueden hacer todo lo que Assist puede hacer. El beneficio adicional es que pueden razonar más allá de las palabras, algo que Assist era incapaz de hacer.

Por ejemplo, si tiene una luz llamada “Lámpara de cámara web” expuesta en su área de “oficina”, puede dar comandos directos como:

Encienda la luz de la cámara web de la oficina.

Esto también funcionó con Assist antes, pero también puedes dar comandos más complejos, como:

Voy a una reunión, ¿puedes asegurarte de que la gente vea mi cara?

El agente determinará la intención detrás de las palabras e invocará la intención correcta en las entidades expuestas correspondientes.

Esta versión está disponible para integraciones. Abierto AI Y IA de Google. Para que sea más fácil comenzar con los LLM, los desarrolladores los han actualizado con parámetros de modelo recomendados que logran un buen equilibrio entre precisión, velocidad y costo.

La configuración recomendada funciona igual de bien para las tareas del asistente de voz. Google es 14 veces más barato que OpenAI, pero OpenAI responde mejor a las preguntas sobre hogares no inteligentes.

Los LLM locales también son compatibles mediante la integración deOllama desde Asistente de hogar 2024.4. Ollama y los principales modelos LLM de código abierto no están optimizados para la llamada de herramientas, por lo que deben crearse desde cero.

Controles simplificados del reproductor multimedia

Esta actualización presenta nuevas intenciones para los reproductores multimedia que le permiten hacer más diciendo menos. Puede decir los siguientes comandos de voz para controlar reproductores multimedia ubicados en la misma área que su dispositivo Assist:

- Romper

- para reanudar

- Siguiente

- Establecer el volumen al 50%

Hasta ahora, Home Assistant solo ofrecía frases dirigidas a una entidad específica por su nombre. Debido a esta limitación, estas intenciones no eran las más fáciles de usar, ya que las frases eran demasiado largas para decir: «Pasar a la siguiente canción en el televisor de la sala».

Por tanto, los desarrolladores añadieron dos funciones para obtener las frases más cortas posibles. Tener en cuenta el contexto permite al asistente de voz saber qué dispositivos se encuentran en la misma zona que el satélite. También crearon una estrategia de coincidencia inteligente que ayuda a encontrar el reproductor multimedia adecuado al que apuntar.

Por ejemplo, si dice «pausa», el asistente de voz se dirigirá automáticamente al reproductor multimedia que se está reproduciendo actualmente. Solo asegúrese de que su asistente de voz esté asignado a un área con un reproductor multimedia y ¡listo! Los controles se vuelven mucho más naturales aquí.

Personalización de paneles

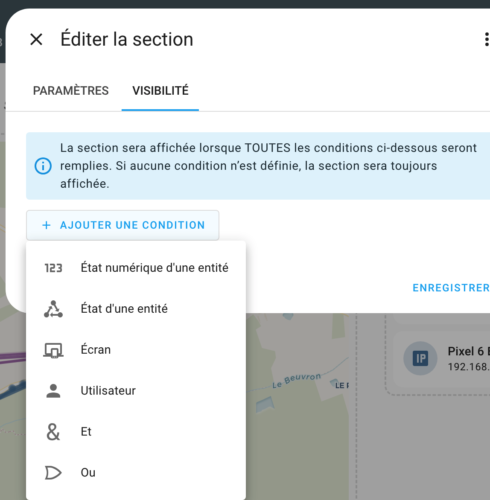

La personalización y organización de los paneles continúa un poco después de las últimas actualizaciones. Este mes, una nueva característica permite que ciertas partes de la sección del tablero se muestren de manera condicional. Esta nueva característica te permite ocultar o mostrar una sección en función de ciertas condiciones que tú decidas.

Por ejemplo, es posible que desees ver una sección solo en el móvil cuando estés en casa. O bien, muestre el interruptor para apagar las luces de la cocina solo cuando estén encendidas. ¿Quizás tienes una sección que sólo te concierne a ti o a tu pareja y quieres ocultarla a los niños?

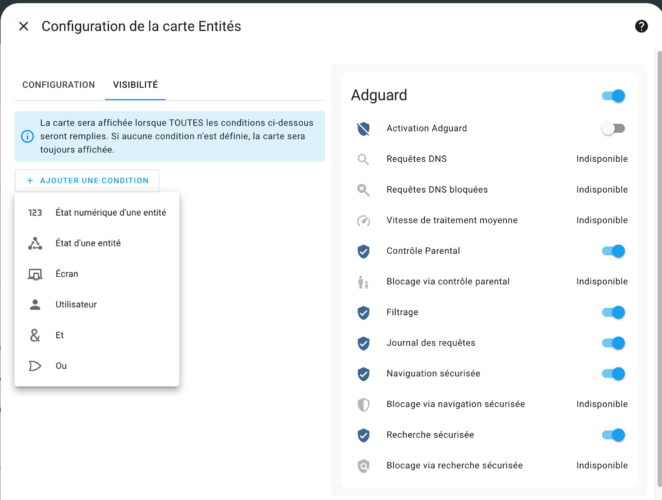

¡Esta misma función de visibilidad ahora está disponible para mapas!

Ahora puede ocultar o mostrar un mapa según determinadas condiciones. Esto le permite crear paneles más dinámicos que se adaptan a sus necesidades. La gran diferencia es que no necesitas una tarjeta de condiciones para utilizar esta función. ¡Está disponible directamente en la configuración del mapa, en la pestaña Visibilidad!

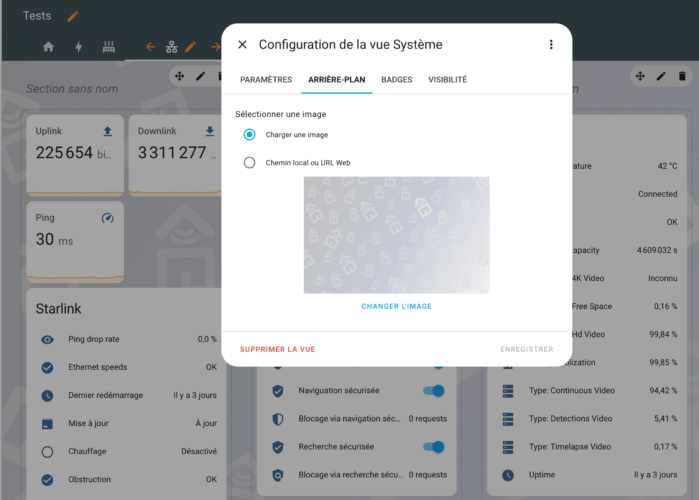

Otra característica nueva en la interfaz del tablero: ¡la capacidad de establecer una imagen de fondo! Anteriormente, esto solo era posible editando YAML, pero ahora puedes hacerlo directamente desde la interfaz de usuario. Mejor aún, puedes cargar una imagen directamente desde tu computadora o proporcionar la URL de una imagen.

Tablas de datos mejoradas

Ahora es posible colapsar y expandir todos los grupos a la vez.

Además, los filtros que configura en las tablas de datos ahora se guardan en su sesión de navegación. Esto significa que si sales de la página y regresas, tus filtros seguirán ahí. Cada pestaña o ventana del navegador tiene su propia sesión, lo que significa que puede tener diferentes filtros en diferentes pestañas o ventanas que se recuerdan para esa pestaña o ventana específica.

Integraciones

Están surgiendo nuevas integraciones:

- gradiente aéreo: Proporciona datos de calidad del aire desde su dispositivo Airgradient local.

- sistemas AP: Supervisa sus microinversores APsystems EZ1, como el que se utiliza, por ejemplo, en el Estación solar Solaris Go !

- Explorador de datos de Azure: reenvía eventos desde Home Assistant a Azure Data Explorer para su análisis.

- IMGW-PIB: Datos hidrológicos del Instituto de Meteorología y Gestión del Agua – El Instituto Nacional de Investigación proporciona información sobre ríos y embalses de agua en Polonia.

- Aceleración de almacenamiento inteligente: ISAL (Biblioteca de aceleración de almacenamiento inteligente) se utiliza para acelerar la interfaz de Home Assistant. Se activa automáticamente.

- monzó: Conecte su cuenta bancaria Monzo a Home Assistant y obtenga información sobre el saldo de su cuenta.

Actualizaciones de Matter a la versión 1.3

Como hemos visto recientemente, La materia ha pasado a la versión 1.3.. Well Home Assistant ya se ha adaptado a esta actualización, que mejora la fiabilidad y compatibilidad de los dispositivos Matter.

Esta versión también mejora y amplía la compatibilidad con dispositivos. Los purificadores de aire y los acondicionadores de aire basados en materia ahora son compatibles, los termostatos y otros dispositivos climáticos han tenido correcciones importantes en los puntos de ajuste.

Algunos dispositivos Matter tienen lo que se denomina «clústeres personalizados». Los clústeres personalizados son una forma estandarizada para que los fabricantes incluyan datos no estandarizados. Home Assistant quiere admitir clústeres personalizados, pero los desarrolladores deben agregar soporte para cada uno individualmente.

Esta versión permite que Home Assistant reciba notificaciones cuando cambian los datos de un clúster personalizado (en lugar de solicitarlo a intervalos regulares). Esto reducirá el tráfico de la red y mejorará el rendimiento de su red Matter, especialmente en redes Thread grandes.

¡Las etiquetas se convierten en entidades!

Home Assistant admite etiquetas desde hace mucho tiempo. La función de etiquetas permitía utilizar etiquetas NFC o códigos QR con Home Assistant, por ejemplo, para activar automatizaciones.

Sin embargo, las etiquetas no eran entidades reales y, por lo tanto, su uso no siempre era lógico. Con esta versión, las etiquetas ahora son entidades normales y pueden usarse en automatizaciones, scripts, modelos e incluso agregarse a sus paneles.

Puedes encontrar todas las nuevas funciones en el billete oficial.

Si prefieres descubrir las nuevas funciones rápidamente en vídeo, también te invito a seguir Howmation, que ha planeado un breve vídeo informativo para cada próxima actualización:

Entonces ! ¡Diviértete con todas estas nuevas funciones! Voy a volver ;-)

Por favor, sea cortés: ¡un hola y un gracias no cuestan nada! Estamos aquí para mantener debates constructivos. Los trolls serán eliminados.