Nuovo mese, nuovo aggiornamento di Home Assistant! E questo mese è chiaramente caratterizzato dall’intelligenza artificiale, che ti consente di controllare tutta la tua casa. Non solo con Assist, l'assistente integrato di Home Assistant, ma anche tramite OpenAI (ChatGPT) e Google AI! Le nuove funzionalità però non si fermano qui: abbiamo anche controlli semplicissimi del lettore multimediale, altri miglioramenti alle tabelle di dati, alle entità dei tag, alle sezioni di struttura comprimibili e altro ancora!

Assistenti vocali e intelligenza artificiale

Il cervello dell'assistente vocale è chiamato agente conversazionale. È responsabile della comprensione dell'intenzione dietro il comando vocale, dell'esecuzione di un'azione e della generazione di una risposta.

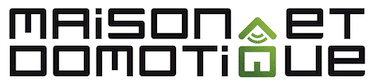

Fin dall'inizio, Home Assistant ha permesso di sostituire il suo agente di chat con un agente basato su LLM. Ma fino ad ora questi due mondi (il chatbot Home Assistant che controlla la tua casa e i chatbot basati su LLM) non si sovrapponevano: era impossibile controllare la tua casa da un chatbot basato su LLM. Dovevi passare attraverso l'uno o l'altro, il che era restrittivo. Bene, ora è risolto! Quando imposti un chatbot basato su LLM, puoi decidere di lasciare che il tuo chatbot controlli la tua casa con la semplice pressione di un pulsante.

Con questa nuova impostazione, i chatbot basati su LLM possono sfruttare il nostro sistema di intenti, che alimenta l'assistente. Hanno inoltre accesso a tutte le entità esposte alla procedura guidata. In questo modo, controlli a cosa hanno accesso i tuoi agenti.

Usare il sistema dell'intenzione è molto interessante perché funziona fin dall'inizio. I chatbot basati su LLM possono fare tutto ciò che Assist può fare. Il vantaggio aggiuntivo è che sono in grado di ragionare oltre le parole, cosa di cui Assist era incapace.

Se ad esempio hai una luce chiamata “Webcam Lamp” esposta nella tua zona “ufficio”, puoi impartire comandi diretti come:

Accendi la luce della webcam dell'ufficio.

Prima funzionava anche con Assist, ma puoi anche dare comandi più complessi, come:

Sto andando a una riunione, puoi assicurarti che le persone vedano la mia faccia?

L'agente determinerà l'intento dietro le parole e invocherà l'intento corretto sulle corrispondenti entità esposte.

Questa versione è disponibile per integrazioni OpenAI E L'intelligenza artificiale di Google. Per facilitare l'avvio dei LLM, gli sviluppatori li hanno aggiornati con i parametri del modello consigliati che raggiungono un buon equilibrio tra precisione, velocità e costi.

Le impostazioni consigliate funzionano altrettanto bene per le attività dell'assistente vocale. Google è 14 volte più economico di OpenAI, ma OpenAI risponde meglio alle domande sulla casa non intelligente.

Anche i LLM locali sono supportati tramite l'integrazione diOllama da Assistente domestico 2024.4. Ollama e i principali modelli LLM open source non sono ottimizzati per le chiamate agli strumenti, quindi è necessario crearli da zero.

Controlli del lettore multimediale semplificati

Questo aggiornamento introduce nuovi intenti per i lettori multimediali che ti consentono di fare di più dicendo di meno. Puoi pronunciare i seguenti comandi vocali per controllare i lettori multimediali situati nella stessa area del tuo dispositivo Assist:

- Rottura

- Per riprendere

- Seguente

- Imposta il volume al 50%

Fino ad ora, Home Assistant offriva solo frasi mirate a un'entità specifica per nome. A causa di questa limitazione, queste intenzioni non erano delle più facili da usare, poiché le frasi erano troppo lunghe da dire: “Passa alla canzone successiva sulla TV del soggiorno”.

Gli sviluppatori hanno quindi aggiunto due funzioni per ottenere frasi più brevi possibili. Prendere in considerazione il contesto consente all'assistente vocale di sapere quali dispositivi si trovano nella stessa area del satellite. Hanno anche creato una strategia di corrispondenza intelligente che aiuta a trovare il lettore multimediale giusto da scegliere come target.

Ad esempio, se dici “pausa”, l'assistente vocale sceglierà automaticamente come target il lettore multimediale attualmente in riproduzione. Assicurati solo che il tuo assistente vocale sia assegnato a un'area con un lettore multimediale e sei a posto! Qui i controlli diventano molto più naturali.

Personalizzazione dei dashboard

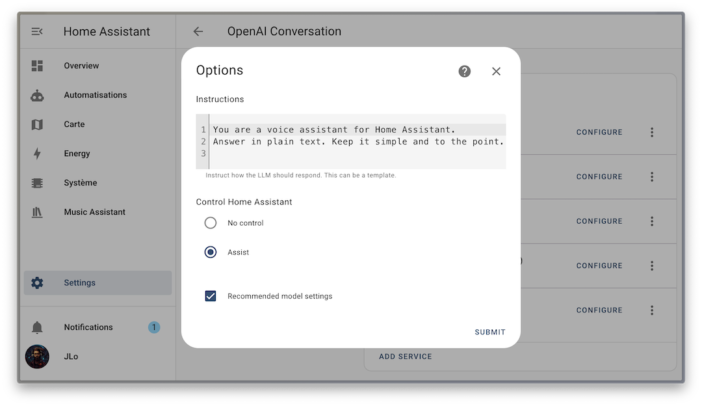

La personalizzazione e l'organizzazione delle dashboard prosegue poco dopo gli ultimi aggiornamenti. Questo mese, una nuova funzionalità consente di visualizzare in modo condizionato alcune parti della sezione del dashboard. Questa nuova funzionalità ti consente di nascondere o mostrare una sezione in base a determinate condizioni che decidi tu.

Ad esempio, potresti voler visualizzare una sezione sui dispositivi mobili solo quando sei a casa. Oppure visualizza l'interruttore per spegnere le luci della cucina solo quando sono accese. Forse hai una sezione che riguarda solo te o il tuo partner e che vuoi nascondere ai bambini?

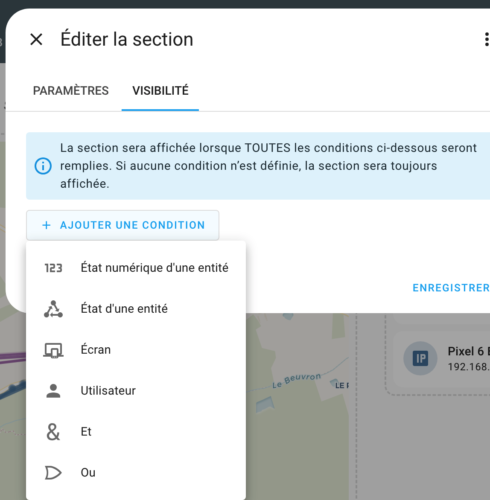

Questa stessa funzionalità di visibilità è ora disponibile per le mappe!

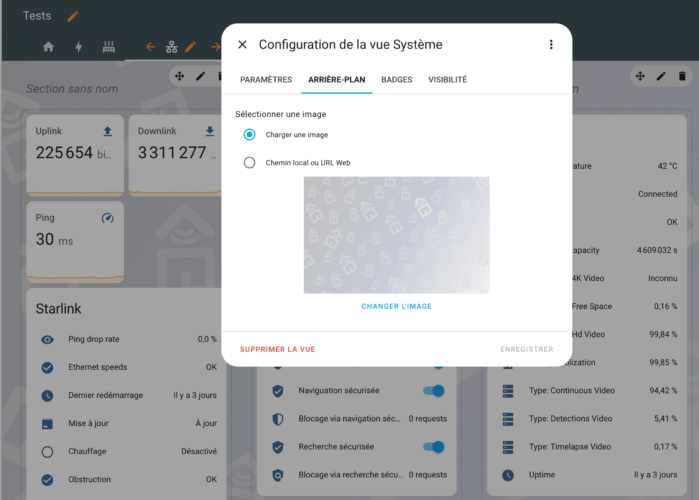

Ora puoi nascondere o mostrare una mappa in base a determinate condizioni. Ciò ti consente di creare dashboard più dinamiche che si adattano alle tue esigenze. La grande differenza è che non hai bisogno di una carta condizioni per utilizzare questa funzione. È disponibile direttamente nella configurazione della mappa, nella scheda Visibilità!

Un'altra nuova funzionalità nell'interfaccia della dashboard: la possibilità di impostare un'immagine di sfondo! In precedenza questo era possibile solo modificando YAML, ma ora puoi farlo direttamente dall'interfaccia utente. Meglio ancora, puoi caricare un'immagine direttamente dal tuo computer o fornire l'URL di un'immagine!

Tabelle dati migliorate

Ora è possibile comprimere ed espandere tutti i gruppi contemporaneamente.

Inoltre, i filtri impostati nelle tabelle di dati vengono ora salvati nella sessione di navigazione. Ciò significa che se lasci la pagina e torni, i tuoi filtri saranno ancora lì. Ogni scheda o finestra del browser ha la propria sessione, il che significa che puoi avere diversi filtri in diverse schede o finestre che vengono ricordati per quella specifica scheda o finestra.

Integrazioni

Stanno emergendo nuove integrazioni:

- Gradiente aereo: fornisce dati sulla qualità dell'aria dal dispositivo Airgradient locale.

- Sistemi AP: Controlla i tuoi microinverter APsystems EZ1, come quello utilizzato ad esempio sul Stazione solare Solaris Go !

- Esplora dati di Azure: inoltra eventi da Home Assistant ad Azure Esplora dati per l'analisi.

- IMGW-PIB: I dati idrologici dell'Istituto di meteorologia e gestione delle acque – Istituto nazionale di ricerca forniscono informazioni sui fiumi e sui bacini idrici in Polonia.

- Accelerazione dello storage intelligente: ISAL (Intelligent Storage Acceleration Library) viene utilizzato per accelerare il frontend di Home Assistant. Si attiva automaticamente.

- Monzo: collega il tuo conto bancario Monzo a Home Assistant e ottieni informazioni sul saldo del tuo conto.

La materia si aggiorna alla versione 1.3

Come abbiamo visto di recente, La questione è passata alla versione 1.3. Ebbene Home Assistant si è già adattato a questo aggiornamento, che migliora l'affidabilità e la compatibilità dei dispositivi Matter.

Questa versione migliora ed espande inoltre il supporto dei dispositivi. I purificatori d'aria e i condizionatori d'aria basati sulla materia sono ora supportati, i termostati e altri dispositivi climatici hanno subito correzioni significative attorno ai setpoint.

Alcuni dispositivi Matter dispongono dei cosiddetti “cluster personalizzati”. I cluster personalizzati rappresentano un modo standardizzato con cui i produttori possono includere dati non standardizzati. Home Assistant vuole supportare cluster personalizzati, ma gli sviluppatori devono aggiungere il supporto per ciascuno individualmente.

Questa versione consente a Home Assistant di ricevere una notifica quando i dati di un cluster personalizzato cambiano (invece di richiederlo a intervalli regolari). Ciò ridurrà il traffico di rete e migliorerà le prestazioni della tua rete Matter, in particolare su reti Thread di grandi dimensioni.

I tag diventano entità!

Home Assistant supporta i tag da molto tempo. La funzione tag ha permesso, ad esempio, di utilizzare tag NFC o codici QR con Home Assistant per attivare automazioni.

Tuttavia, i tag non erano entità reali e pertanto non erano sempre logici da utilizzare. Con questa versione, i tag sono ora entità normali e possono essere utilizzati in automazioni, script, modelli e persino aggiunti alle dashboard!

Puoi trovare tutte le novità nel biglietto ufficiale.

Se preferisci scoprire velocemente le nuove funzionalità in video, ti invito anche a seguire Howmation, che ha previsto un breve video debriefing per ogni prossimo aggiornamento:

COSÌ ! Divertiti con tutte queste nuove funzionalità! Torno indietro ;-)